Oletko koskaan miettinyt, voisitko ajaa jotain ChatgPT: tä paikallisesti Macissa tarvitsematta Internetiä? Vain vähän asennuksella voit todella. Se myös ilmaiseksi. Haluatpa pitää keskustelut yksityisenä tai haluat vain offline -pääsyn AI: lle, näin voit suorittaa voimakkaita suuria kielimalleja paikallisesti Mac -Macissa.

Mitä tarvitset LLM: n ajamiseen paikallisesti Macilla?

Ennen kuin sukellamme sisään ja tarkista asennus, tässä tarvitset:

- Mac, jossa on omenapii (M1, M2 tai M3 suositeltu)

- Ainakin 8 Gt: n RAM (vähintään 16 Gt on parempi)

- Noin 4–10 Gt vapaata levytilaa (mallista riippuen)

- Toimiva Internet -yhteys (vain asennusta varten)

- Perusperhe MacOS -päätelaitteen käytön käytöstä (sinun ei tarvitse olla ammattilainen)

Kuinka ajaa LLM paikallisesti Macilla

Käytämme ilmaista Ollama -nimistä työkalua, jonka avulla voit ladata ja ajaa LLMS paikallisesti vain muutamalla komennolla. Näin pääset aloittamaan:

Vaihe 1: Asenna Homebrew (ohita, jos jo asennettu)

HomeBrew on MacOS: n pakettihallinta, joka auttaa sinua asentamaan sovelluksia päätelaitteesta. Jos sinulla on jo asennettu kotibrew Maciin, voit ohittaa tämän vaiheen. Mutta jos et, niin voit asentaa sen:

- Avaa terminaalisovellus laukaisusta tai valokeilasta.

- Kopioi ja liitä seuraava komento ja paina paluu:

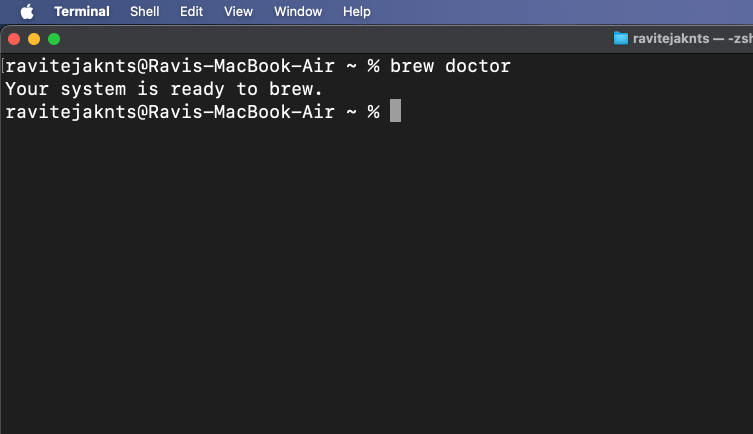

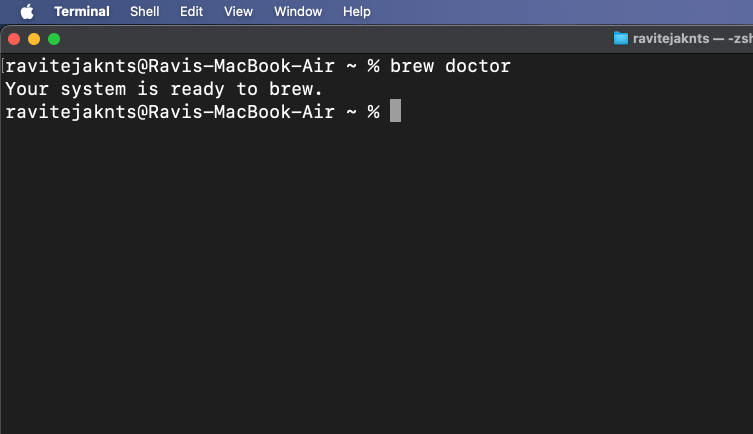

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"- Odota asennuksen valmistumista. Se voi viedä muutaman minuutin. Kun olet valmis, tarkista, toimiiko se kirjoittamalla:

brew doctor

Jos näet ”järjestelmäsi on valmis panostamaan”, olet hyvä mennä.

Jos sinulla on ongelmia tai haluat yksityiskohtaisemman vaiheittaisen prosessin, tutustu oppaamme Homebrew-asentamiseen Maciin.

Vaihe 2: Asenna ja suorita Ollama

Nyt kun Homebrew on asennettu ja valmis käytettäväksi Maciin, asennetaan Ollama:

- Pääteikkunassa: Suorita:

brew install ollama- Asennuksen jälkeen aloita Ollama -palvelu käyttö:

ollama serve

Jätä tämä ikkuna auki tai minimoi se. Tämä komento pitää Ollaman käynnissä taustalla.

Lataa vaihtoehtoisesti Ollama -sovellus ja asenna se kuten mikä tahansa tavallinen Mac -sovellus. Kun olet valmis, avaa sovellus ja pidä se käynnissä taustalla.

Vaihe 3: Lataa ja suorita malli

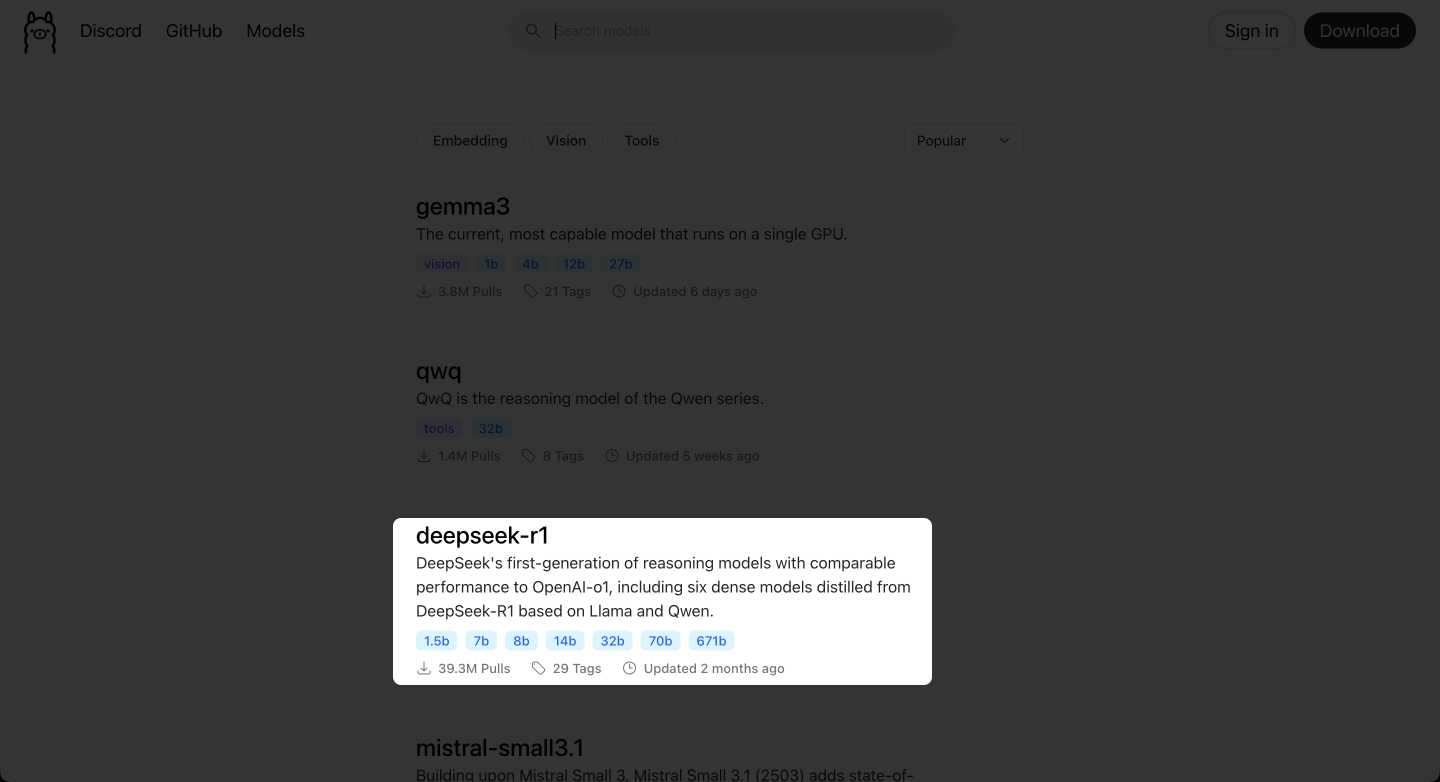

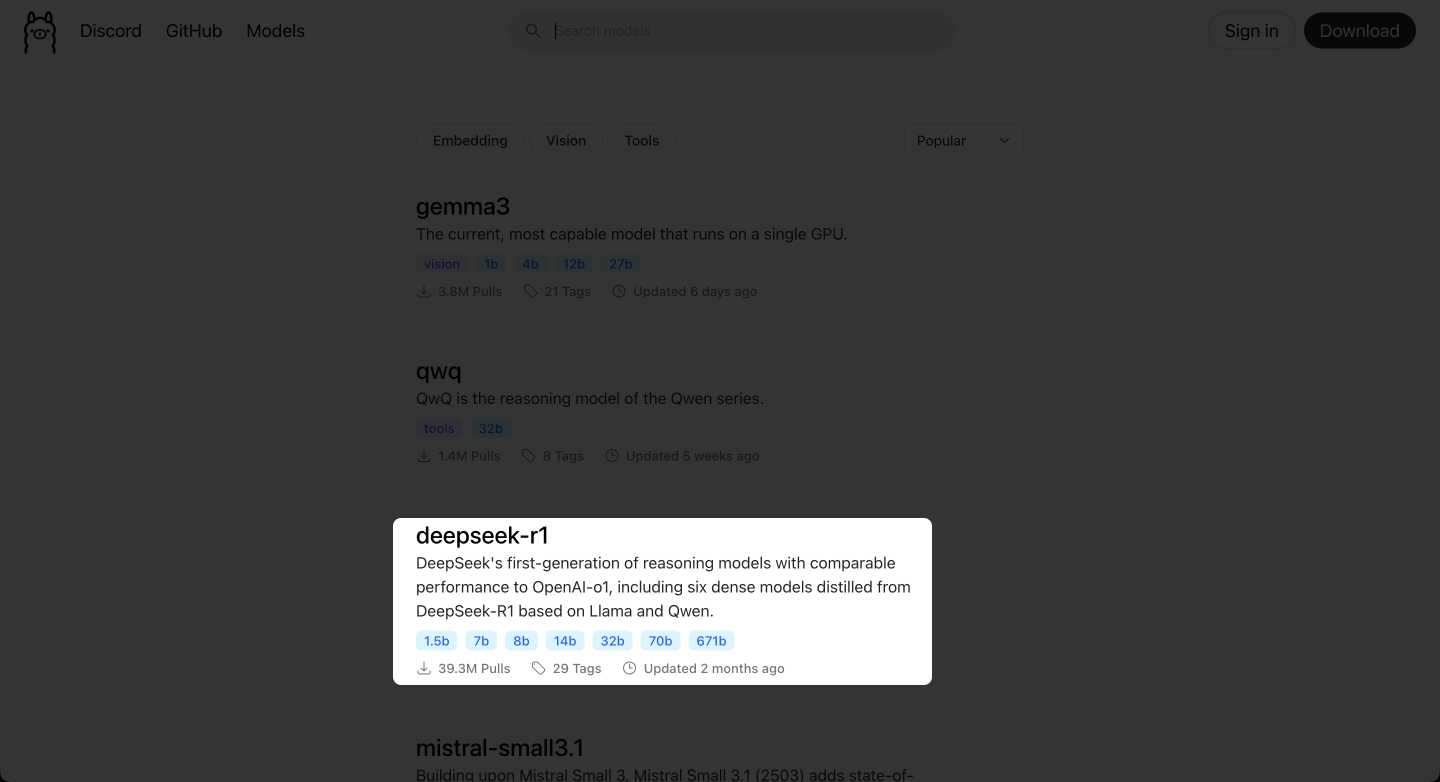

Ollama antaa sinulle pääsyn suosittuihin LLM: iin, kuten Deepseek, Meta’s Llaama, Mistral, Gemma ja paljon muuta. Näin voit valita ja ajaa yhden:

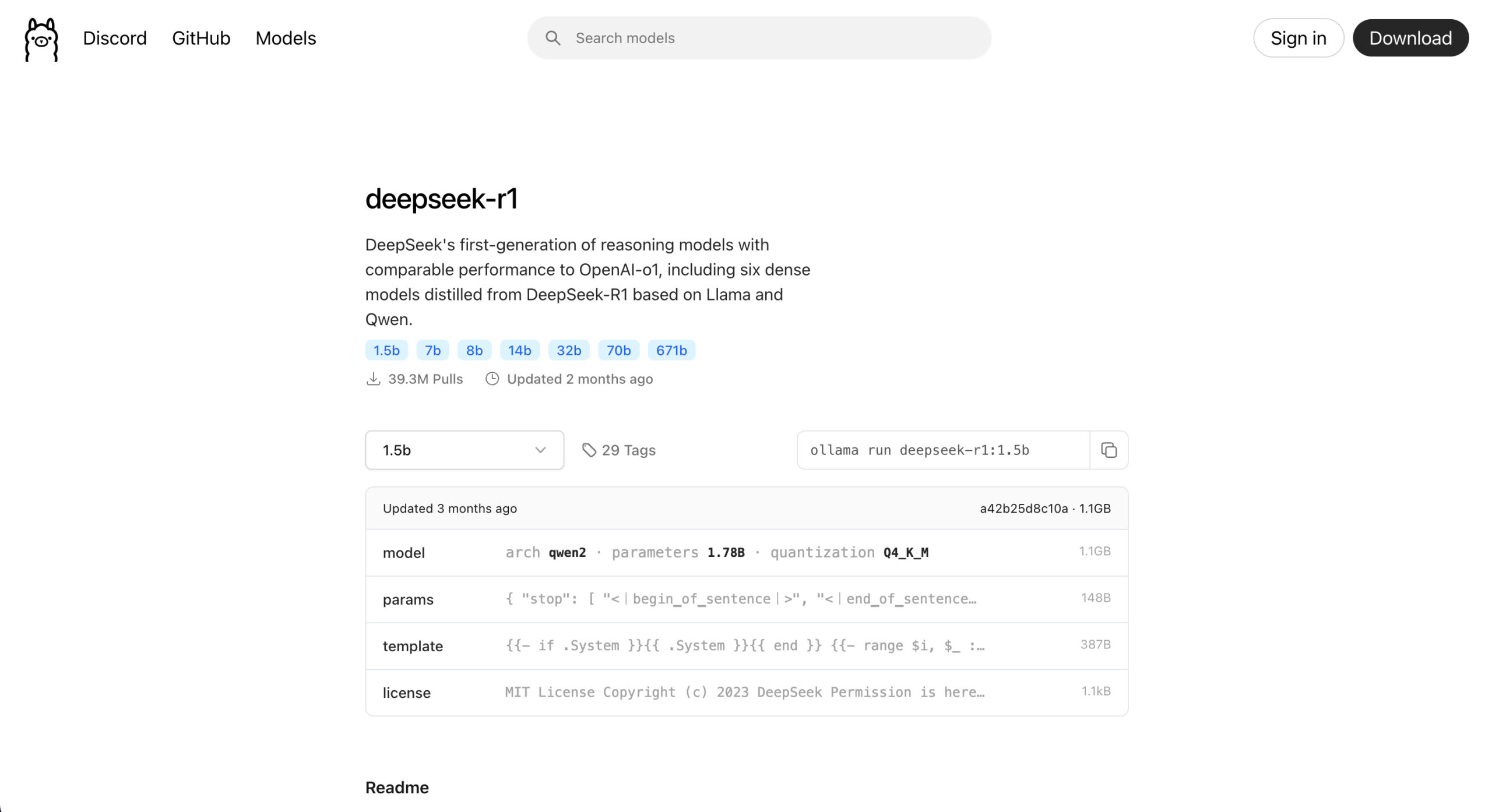

- Käydä Ollama -hakusivu Löydät kaikki AI -mallit, joita voit käyttää paikallisesti Ollaman kautta Macista.

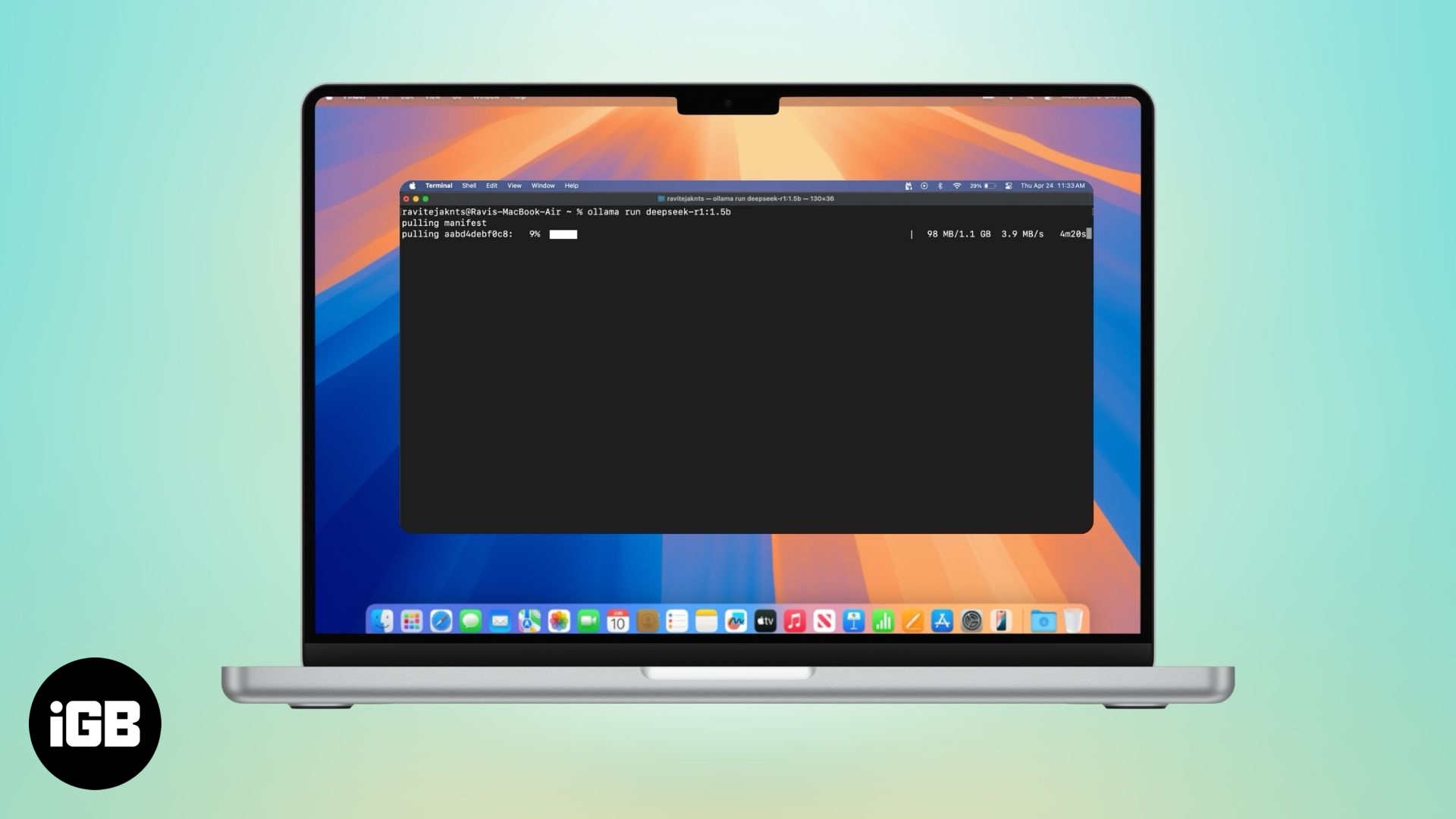

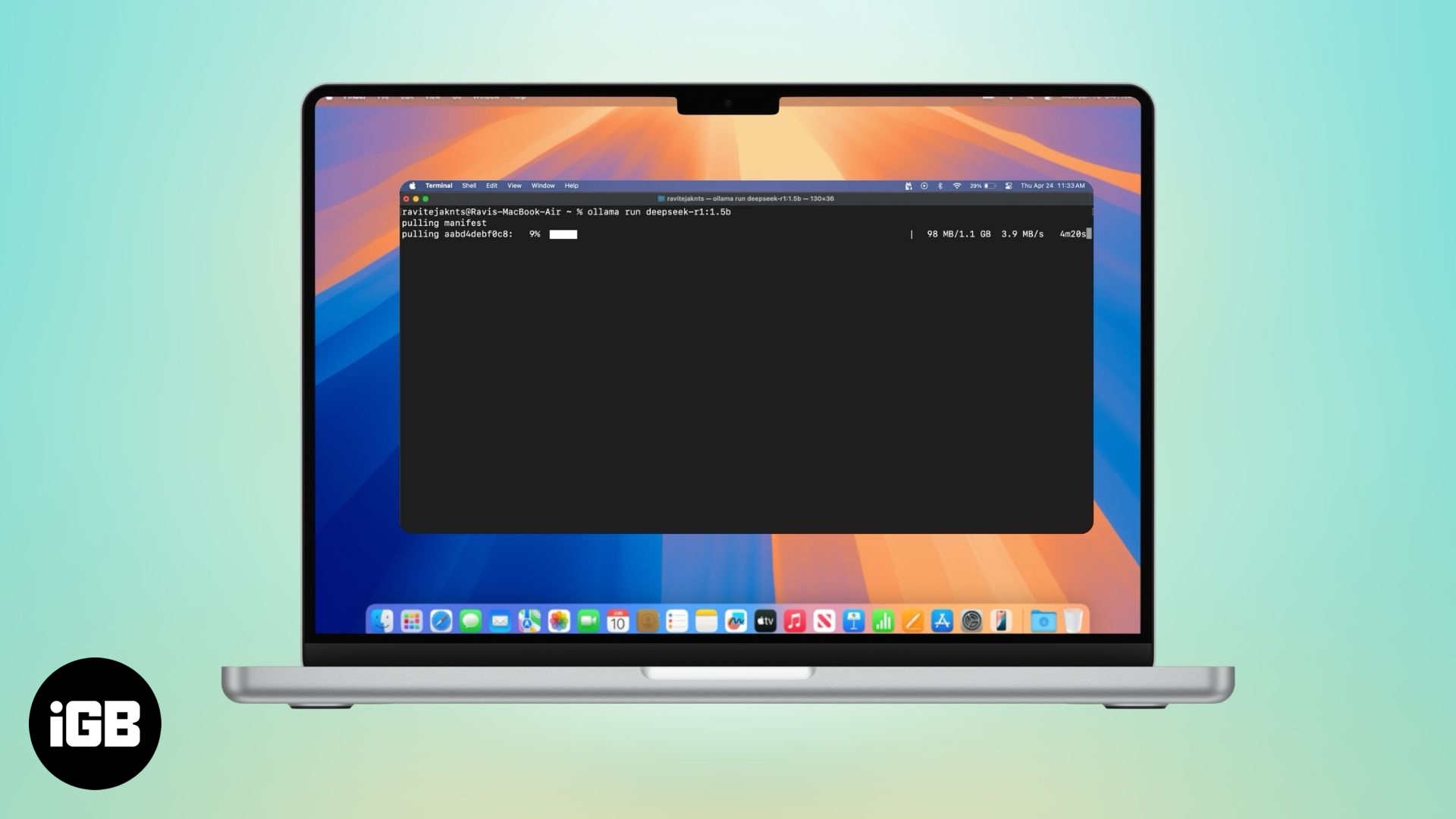

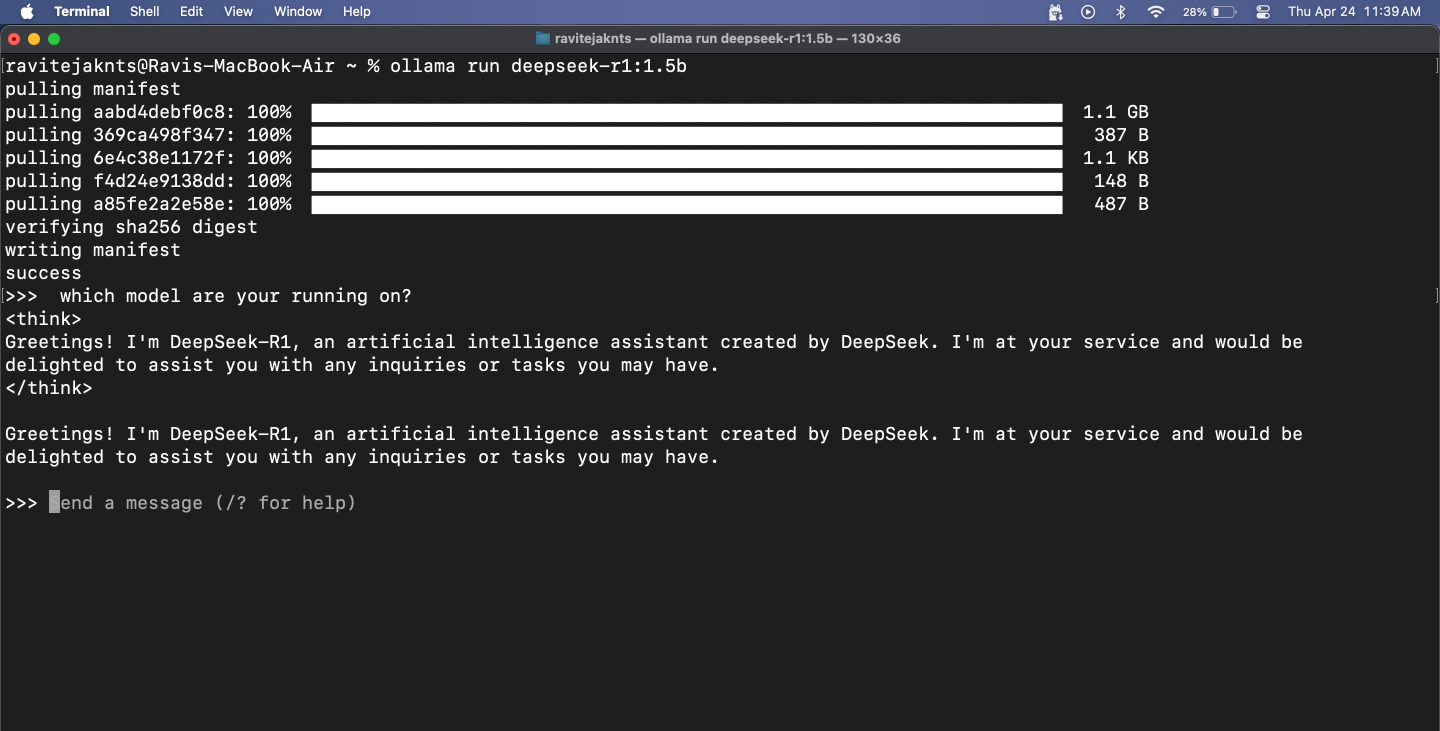

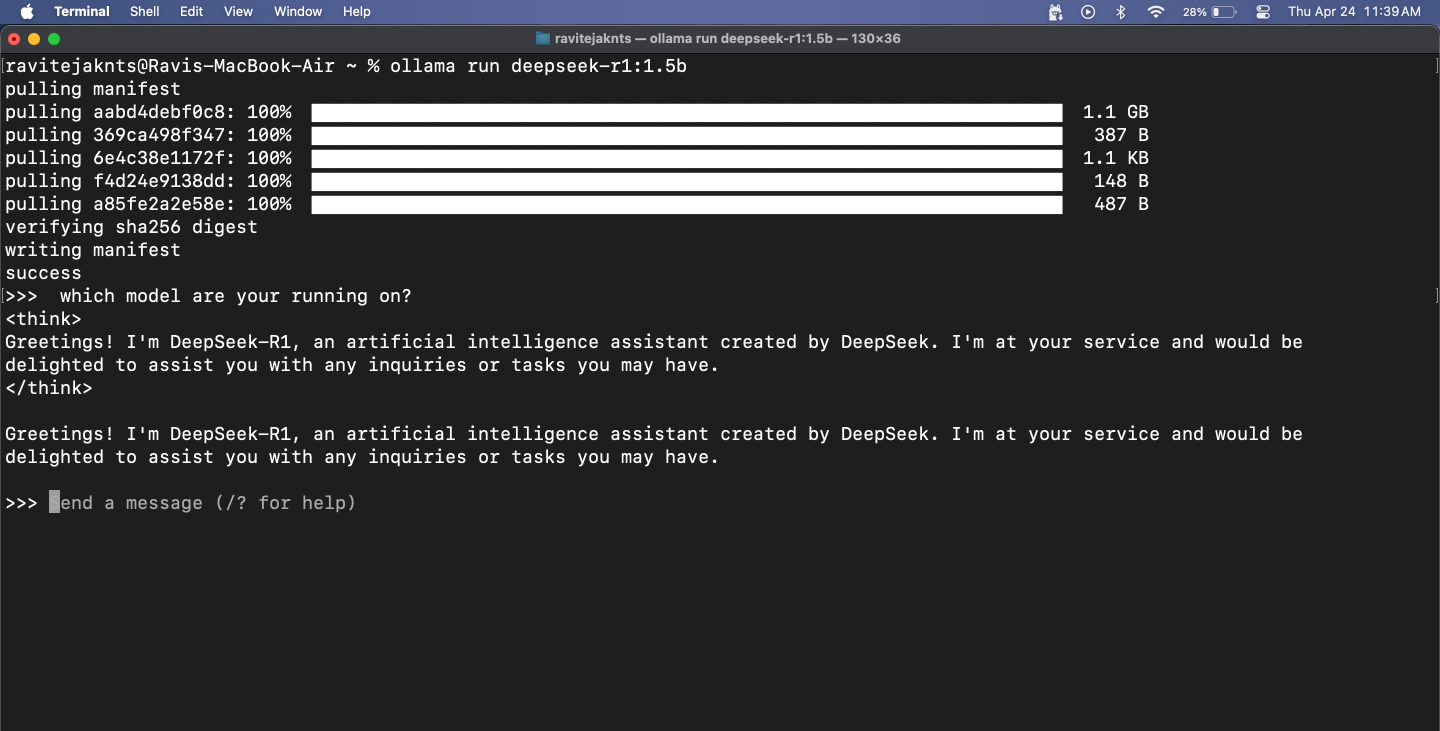

- Valitse asennettava LLM -malli. (Käytän Deepseek-R1: tä, koska se on pieni malli, joka vie vain 1,1 Gt tilaa ja on tehokasta.)

- Tällä sivulla löydät tämän komennon:

ollama run [model-name]. Se on erilainen eri malleissa.

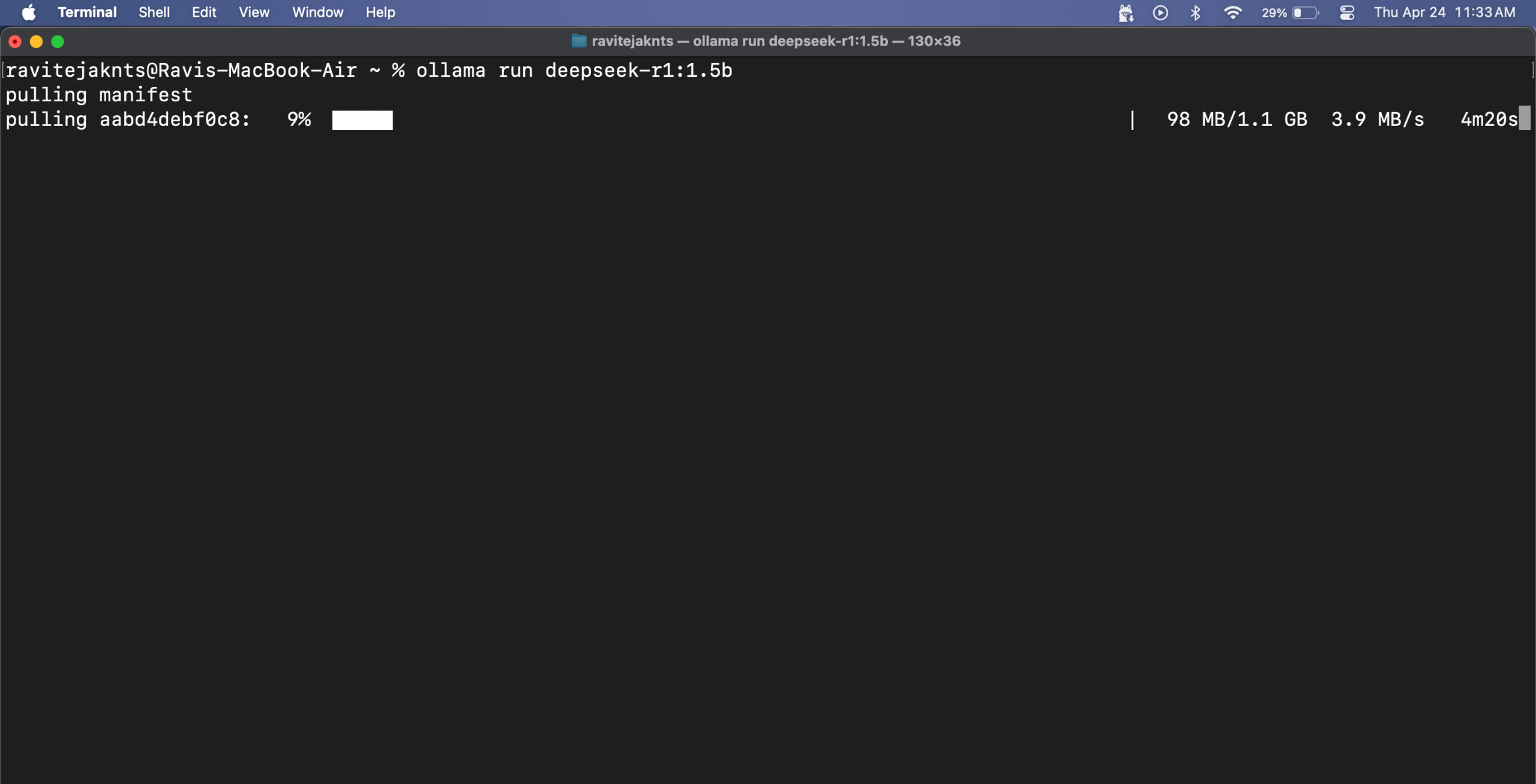

- Deepseek R1 1,5B -malli:

ollama run deepseek-r1:1.5b - Laama 3 -mallille:

ollama run llama3 - Mistralille:

ollama run mistral

- Kopioi ja liitä tämä komento pääteikkunaan. Ensimmäisen kerran kun suoritat tämän, Ollama lataa mallin. Tämä voi kestää muutaman minuutin Internet -nopeudesta riippuen.

- Kun malli on ladattu, näet kehotuksen kirjoittaa syötesi. Keskustelet nyt mallin kanssa!

Jos valitset suuren mallin, odota jonkin verran viivettä – koko malli on paikallisesti MacBookissa. Pienemmät mallit reagoivat nopeammin, mutta ne voivat kamppailee tarkkuudella, etenkin matematiikassa ja logiikkaan liittyvissä tehtävissä. Muista myös, että koska näillä malleilla ei ole Internet-yhteyttä, he eivät voi hakea reaaliaikaista tietoa.

Toisin sanoen, kuten kieliopin, sähköpostien kirjoittamisen tai ideoiden kirjoittamisen tarkistaminen, ne toimivat loistavasti. Olen käyttänyt Deepseek-R1: tä laajasti MacBookissani web-käyttöliittymän asetuksella, jonka avulla voin myös ladata kuvia ja liittää koodinpätkiä. Vaikka sen vastaukset-ja etenkin sen koodaustaidot-eivät ole niin teräviä kuin ylimmän tason malleja, kuten ChatgPT tai Deepseek 671b, se saa silti useimmat jokapäiväiset tehtävät tarvitsematta Internetiä.

Vaihe 4: Keskustele mallin kanssa terminaalissa

Kun malli on käynnissä, voit kirjoittaa viestisi ja paistaa paluu. Malli vastaa juuri alla.

Jos haluat poistua istunnosta, painamalla näppäimistöllä olevaa ohjausta+D. Kun haluat aloittaa juttelun uudelleen, käytä vain samaa ollama run [model-name] komento. Koska malli on jo ladattu, se käynnistyy heti.

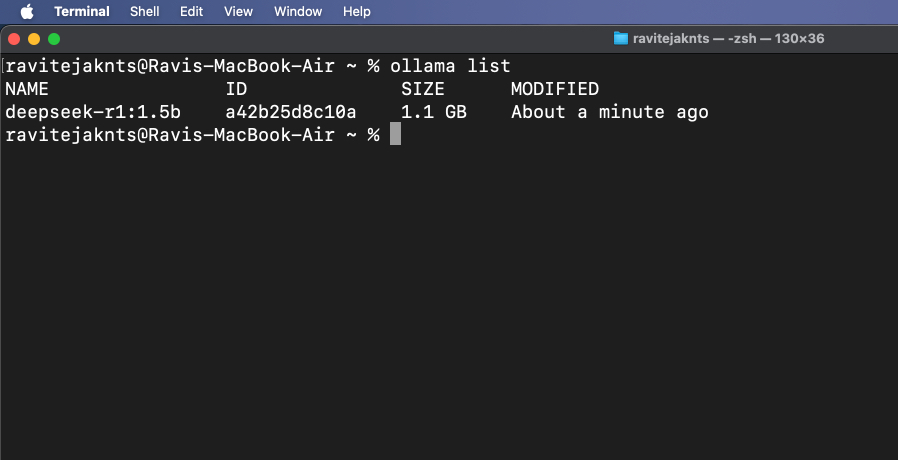

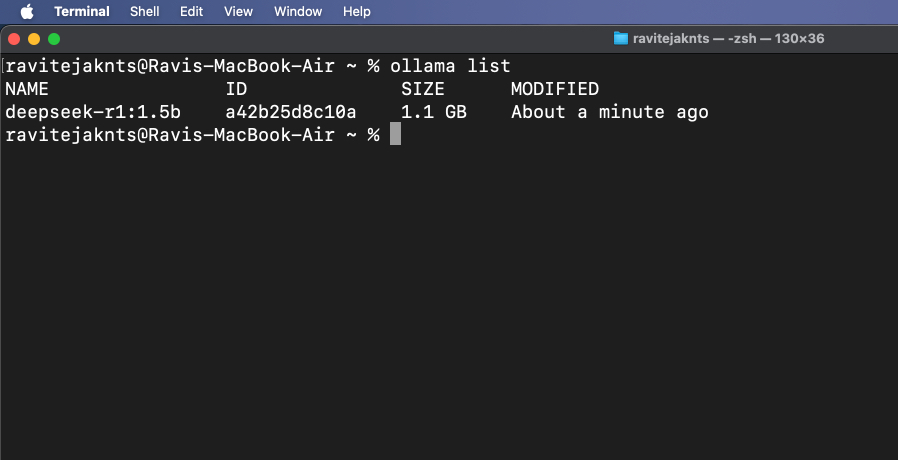

Vaihe 5: Katso ja hallitse asennettuja malleja

Tarkista, mitkä mallit on tällä hetkellä ladattu, suorita:

ollama list

Käytä mallin, jota et enää tarvitse, käytä:

ollama rm [model-name]Bonus: Käytä Ollamaa käyttöliittymän kanssa verkossa

Vaikka Ollama toimii päätelaitteessa, se aloittaa myös paikallisen sovellusliittymän palvelun osoitteessa http: // localhost: 11434, jolloin voit kytkeä sen verkkoliittymään visuaalista vuorovaikutusta mallien kanssa – samanlainen chatbotin käyttämiseksi. Yksi suosittu vaihtoehto tälle on Open Webui, joka tarjoaa käyttäjäystävällisen käyttöliittymän Ollaman ydintoimintojen päällä. Katsotaanpa kuinka asettaa se.

Vaihe 1: Asenna Docker

Docker on työkalu, jonka avulla voit pakata ohjelman ja kaikki sen olennaiset elementit kannettavaan säilöön, jotta voit käyttää sitä helposti millä tahansa laitteella. Käytämme sitä avaamaan verkkopohjaisen chat-käyttöliittymän AI-mallillesi.

Jos Macilla ei ole jo sitä, seuraa näitä vaiheita Dockerin asentamiseen:

- Ladata Docker -työpöytä Suorita se Macille ja noudata näytön ohjeita asennuksen suorittamiseksi.

- Käynnistä Docker -sovellus ja kirjaudu sisään.

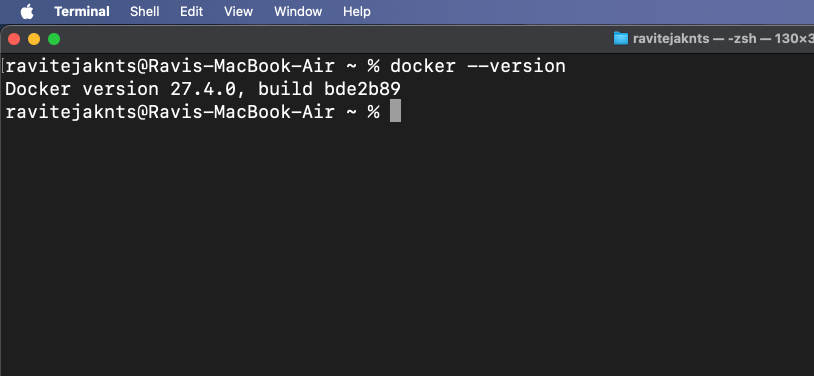

- Avaa pääte ja kirjoita alla oleva komento vahvistaaksesi asennuksen:

docker --version

Jos komento palauttaa versionumeron, se tarkoittaa, että Docker on asennettu Maciin.

Vaihe 2: Vedä avoin Webui -kuva

Avaa Webui on yksinkertainen työkalu, joka antaa sinulle chat -ikkunan selaimessa. Kuvan vetäminen tarkoittaa vain sen suorittamiseen tarvittavien tiedostojen lataamista.

Siirry tämän tekemiseen päätelaitteeseen ja kirjoita:

docker pull ghcr.io/open-webui/open-webui:mainTämä lataa käyttöliittymän tarvittavat tiedostot.

Vaihe 3: Suorita Docker -säilö ja avaa Webui

Nyt on aika ajaa avoin Webui Dockerin avulla. Näet puhtaan käyttöliittymän, jossa voit keskustella AI: n kanssa – mitään terminaalia ei tarvita. Tässä on mitä sinun on tehtävä:

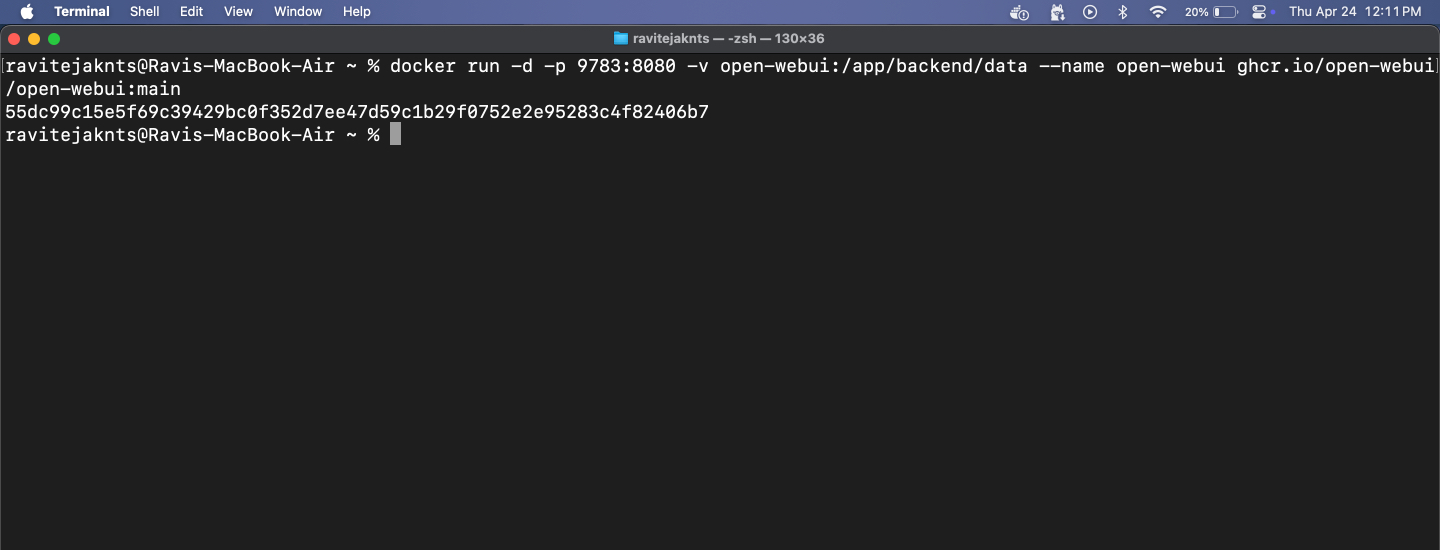

- Käynnistä Docker -säilö pysyvällä tietojen tallennus- ja kartoitetulla porteilla:

docker run -d -p 9783:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main

- Odota muutama sekunti säiliön alkamiseen.

- Avaa selaimesi ja siirry osoitteeseen:

http://localhost:9783/- Luo tili, kun pyydetään, ja sinut ohjataan pääliittymään.

Täältä voit keskustella minkä tahansa asennetun mallin kanssa puhtaassa, käyttäjäystävällisessä selainliittymässä. Tämä vaihe on valinnainen, mutta se antaa sinulle sujuvamman chat -kokemuksen käyttämättä päätettä.

Mac, AI: Ei palvelimia, ei jousia

Se on! Vain muutamassa vaiheessa olet perustanut Mac -palvelun tehokkaan AI -mallin suorittamiseen kokonaan offline -tilassa. Ei tilejä, pilviä eikä Internetiä tarvita asennuksen jälkeen. Haluatpa yksityisiä keskusteluja, paikallista tekstin luomista vai haluatko vain kokeilla LLM: ää, Ollama tekee siitä helpon ja helposti saavutettavan – vaikka et ole kehittäjä. Kokeile!

Katso myös nämä hyödylliset oppaat:

- Kuinka suorittaa Android -sovelluksia Macissa

- Kuinka seuloa nact -levylle

- Kuinka asentaa git Maciin